在数字化转型浪潮中,企业的核心业务系统正面临前所未有的挑战。一方面,传统单体或臃肿的业务系统难以应对用户量的激增与业务的快速迭代,导致性能瓶颈和运维成本高昂,“核心业务瘦身”已成为提升敏捷性和竞争力的关键举措。另一方面,在线数据处理与交易处理业务(OLTP)每时每刻都在产生海量数据,如何实时、准确地处理这些数据,并将其转化为业务洞察,成为制胜未来的核心能力。本文将手把手带你探索,如何在核心业务“瘦身”重构的背景下,构建一个稳定、高效、可扩展的海量数据实时处理架构。

第一部分:为何“核心业务瘦身”需要实时处理架构护航?

传统的“巨石型”业务系统通常将数据存储、业务逻辑、事务处理高度耦合。这不仅使系统变得笨重,难以扩展,更让实时数据分析成为奢望。“瘦身”的本质是微服务化、服务解耦和领域驱动设计,旨在构建一个个轻量、自治、专注的业务服务。

业务拆分后,数据却变得更加分散。订单、用户、库存、支付等数据散落在各个微服务数据库中。此时,业务对全局数据的实时洞察需求反而更加强烈:

- 实时风控:在交易发生的毫秒间识别欺诈行为。

- 实时监控:动态追踪业务大盘、系统健康度与用户行为。

- 实时推荐:根据用户当前操作实时推送个性化内容。

- 实时报表:管理层需要看到分钟级甚至秒级的业务数据。

因此,一个独立于核心交易链路之外的海量数据实时处理架构,就成为承接“瘦身”后核心业务数据、赋能实时决策的“神经系统”。它确保在线交易处理(OLTP)系统轻装上阵、专注事务,同时将数据变化实时同步、加工、分析,形成闭环价值。

第二部分:手把手搭建海量数据实时处理架构核心四层

一个典型的实时处理架构可分为四层:数据采集、数据传输、实时计算与数据存储、应用服务。

第一层:实时数据采集 – “感官网络”

目标是低侵入、无阻塞地捕获核心业务系统的每一条数据变更。

- 首选方案:变更数据捕获(CDC)。通过监听数据库的Binlog(如MySQL)或WAL(如PostgreSQL),将数据的插入、更新、删除事件实时流式化。工具如 Debezium,它能将数据库变更转换为事件流,对业务系统近乎零影响。

- 补充方案:应用日志埋点。对于无法通过CDC捕获的业务事件(如某些业务状态变更),可通过结构化日志(如JSON格式)输出,再由 Flume 或 Filebeat 收集至消息队列。

第二层:数据传输与缓冲 – “高速公路”

承接高吞吐的数据流,并解耦采集与计算过程,起到削峰填谷的作用。

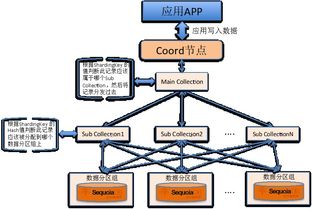

- 消息队列(Kafka)是此层的基石。它将CDC或日志产生的事件序列化为Topic,其高吞吐、持久化、分区和容错特性完美契合实时流需求。建议按业务域或数据主题(如

order<em>events,user</em>events)划分Topic,便于管理。

第三层:实时计算引擎 – “智慧大脑”

这是架构的核心,负责对数据流进行实时转换、聚合、分析与建模。

- 流处理框架选型:

- Apache Flink:当前实时处理领域的首选。它提供了精确一次(Exactly-Once)语义、丰富的API(DataStream API/SQL)、强大的状态管理和窗口计算能力,非常适合做复杂事件处理(CEP)、实时聚合(如每分钟GMV)和流批一体作业。

- Apache Spark Streaming:基于微批处理(Micro-Batch),适合对延迟要求稍宽松(秒级)但需要与批处理共享代码的场景。

- 典型计算任务:

- ETL:清洗、标准化来自不同业务的数据。

- 实时聚合:计算实时销售额、热门商品、用户在线数等。

- 流式关联:将订单流与用户流、商品流实时关联,生成宽表。

- 异常检测:基于规则或模型实时识别交易异常。

第四层:数据存储与服务 – “决策宝库”

经过计算处理的结果需要存储并提供低延迟查询服务。

- 实时OLAP数据库:用于即席查询与多维分析。

- ClickHouse:以极致的查询速度著称,适合做大宽表的实时聚合分析。

- Apache Doris:兼容MySQL协议,支持高并发点查和批量导入,使用更友好。

- 高速KV存储:用于实时查询单个实体的最新状态,如用户画像、商品库存。

- Redis:内存存储,延迟极低。

- TiKV:分布式、强一致的KV存储,容量更大。

- 数据服务层:通过统一的API网关或RPC服务,将存储在OLAP或KV中的数据封装成接口,提供给前端应用、风控系统或推荐系统调用。

第三部分:架构实践:以“实时交易大盘”为例

假设我们有一个已“瘦身”的电商微服务集群(订单服务、用户服务、商品服务)。现在需要搭建一个实时交易数据大屏。

- 数据采集:在订单、支付服务的数据库上部署Debezium Connector,捕获订单创建、支付成功等核心事件,写入Kafka的

order_cdcTopic。

2. 实时计算:使用Flink任务消费 order<em>cdc 数据流。

- 通过Flink SQL,对支付成功事件流按 1分钟 的滚动窗口进行聚合:

`sql

SELECT

DATEFORMAT(paytime, 'yyyy-MM-dd HH:mm') as minute,

COUNT(orderid) as ordercount,

SUM(amount) as gmv

FROM orderstream

WHERE status = 'PAIDSUCCESS'

GROUP BY TUMBLE(paytime, INTERVAL '1' MINUTE), DATEFORMAT(paytime, 'yyyy-MM-dd HH:mm')

`

- 将聚合结果(每分钟订单量、GMV)实时写入ClickHouse的

real<em>time</em>dashboard表。

- 数据服务与展示:大屏后端服务直接查询ClickHouse,获取最近几小时的分钟级聚合数据,通过WebSocket或HTTP API推送到前端大屏实时刷新。

第四部分:关键挑战与最佳实践

- 数据一致性:确保从业务数据库到最终数据视图的端到端一致性。利用Flink的Exactly-Once语义和Kafka事务生产者。

- 容错与高可用:所有组件(Kafka, Flink, ClickHouse)均需集群化部署。Flink需配置Checkpoint和Savepoint,实现任务状态持久化和故障恢复。

- 资源隔离:实时处理集群应与核心OLTP业务在物理或逻辑资源上隔离,避免相互干扰。

- 架构演进:初期可从核心业务最重要的1-2个数据流开始,快速验证价值,再逐步扩展。

###

核心业务“瘦身”与海量数据实时处理架构的建设,是一体两面、相辅相成的战略举措。“瘦身”让业务更敏捷,而实时处理架构则让数据产生即时的智慧。通过CDC、Kafka、Flink、ClickHouse等现代数据栈的有机组合,企业能够构建起从在线交易到实时决策的“数据高速公路”。这不仅是对当前在线数据处理与交易处理业务的强大赋能,更是面向未来数据驱动商业模式的坚实奠基。现在,就从你最关心的一个业务流开始,动手搭建属于你自己的实时处理架构吧!